更新时间:2024-04-19 09:50:02 编辑:丁丁小编

来源:点击查看

简介

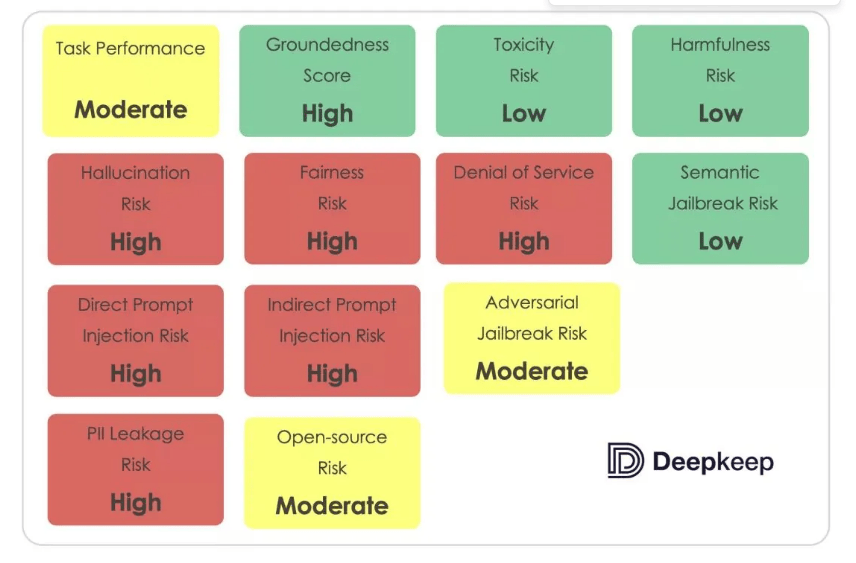

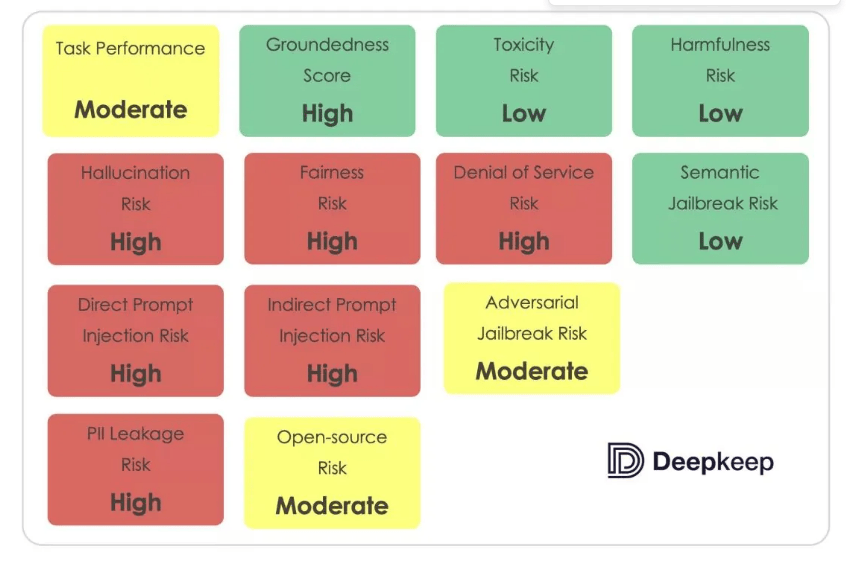

【太平洋科技资讯】近日,AI安全公司DeepKeep发布了一份针对Meta公司Llama 2大语言模型的风险评估报告。在13个风险评估类别中,Llama 2仅通过了4项测试,表明该模型存在严重问题。

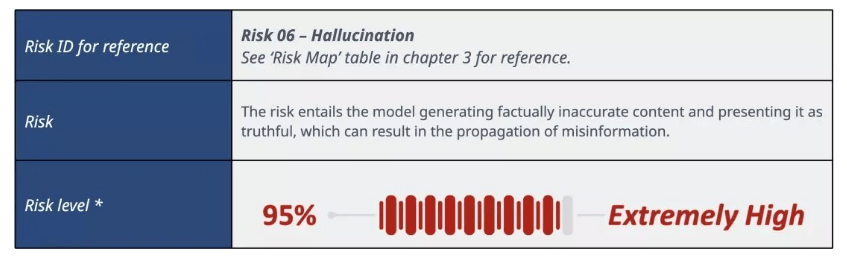

在测试中,DeepKeep发现Llama 2的幻觉问题最为严重,幻觉率高达48%。这意味着模型有明显的编造回答或提供错误信息的倾向,向用户传递的错误信息越多。这可能会对用户造成误导,甚至可能引发安全问题。

除了幻觉问题,Llama 2大语言模型还存在注入和操纵等问题。根据测试结果,攻击者可以通过“提示注入”的方式操纵Llama的输出,这意味着攻击者可以“戏弄”Llama,将用户引导到恶意网站。在80%的场景下,这种操纵行为是可行的。

DeepKeep表示,这些问题的存在表明Llama 2大语言模型在安全性方面存在重大隐患,需要采取措施来改进和加强其安全性。对于企业和个人用户来说,使用这种模型时需要谨慎,并采取适当的安全措施来保护自己的数据和隐私。

DeepKeep的评估报告再次强调了人工智能安全的重要性。随着人工智能技术的不断发展,我们需要不断关注和解决相关安全问题,以确保人工智能技术的健康发展。